.gif)

lo + visto

lo + comentado

22 | YPF, Puma, Shell, Axion: el preci...

22 | Irán respondió a Milei tras def...

20 | La estrategia de agentes del DHS ...

19 | Viaje de riesgo a Santa Fe y el s...

17 | Es oficial: qué pasa con el feri...

16 | ¿Es feriado el lunes 23 de marzo...

14 | YPF, Puma, Shell, Axion: el preci...

13 | De la paradoja K a la mancha vene...

Horóscopo

Cotizaciones

.gif)

La Nación Neurocientíficos, militares y un preso: así trabaja el grupo que “hackea” la IA de Microsoft antes de que llegue al público

22/03/2026

| 7 visitas

La compañía cuenta con un “equipo rojo” que evalúa todas las inteligencias artificiales antes de su lanzamiento, y las frena si es necesario

MADRID.- Brad Smith, presidente de Microsoft, se toma un segundo para reflexionar y usa la palabra “guardarraíles” con la naturalidad de quien pensó mucho en los precipicios. Se celebran unas jornadas sobre la innovación de la compañía en su sede de Redmond (EE.UU.), al que han sido invitados este y otros diarios internacionales, y EL PAÍS le pregunta cómo y quién determina si la inteligencia artificial (IA) de la empresa puede ser utilizada en un contexto de guerra, como el actual. Hace tan solo unos días que se hizo público que la firma de IA Anthropic ha demandado al Pentágono por vetarla tras marcar líneas rojas en el uso de su tecnología. Es el debate del momento en el mundo de las grandes tecnológicas, y es un asunto muy familiar para Microsoft: en 2021, el Pentágono canceló un acuerdo de US$10.000 millones con la firma tras las protestas de sus empleados. Microsoft, de hecho, apoya a Anthropic en su pelea con el Pentágono.Smith responde: “Tenemos principios, los definimos y los publicamos. Por definición, esos principios crean guardarraíles. Y nos mantenemos en la carretera dentro de ellos. No se trata solo de cuándo debemos usar la tecnología, sino también de cuándo no debemos usarla”.Microsoft tiene para ello un equipo que hackea sus propios productos: el “equipo rojo” o red team. El nombre tiene historia militar. Los red teams surgieron en los ejércitos para simular ataques enemigos y detectar vulnerabilidades propias antes de que lo hiciera el adversario real. En ciberseguridad, la práctica lleva décadas establecida. Pero aplicarla a la IA generativa es algo relativamente nuevo, y Microsoft se atribuye haber sido pionera, al formar este equipo en 2018.“Antes de que se lance un producto, los equipos rojos ‘rompen’ la tecnología para que otros puedan reconstruirla más sólida y segura”, explica Ram Shankar Siva Kumar, “cowboy de datos”, según se autodenomina, y líder del equipo rojo. “La IA puede provocar problemas, desde fallas de seguridad hasta daños psicosociales. La gente usa Copilot [la IA de Microsoft] en momentos de gran vulnerabilidad, así que observar cómo pueden fallar estos sistemas antes de que lleguen al usuario es una cuestión fundamental”, explica.Esta especie de “asuntos internos" de la IA analizó ya más de 100 productos de la compañía. Microsoft no ofrece datos de cuántas personas trabajan en él, ni sobre si se han parado productos ni cuáles. Pero sí asegura que el equipo tiene el poder para hacerlo: “Ningún sistema de IA de alto riesgo se implementa sin antes someterse a una prueba independiente. Si nuestro equipo identifica riesgos graves que no se han mitigado, el producto no se lanza hasta que se resuelvan esos problemas”, asegura Kumar.La pregunta que se hace el equipo a la hora de analizar un producto antes de que sea lanzado es: “¿Cómo podría usarse este sistema de IA, para bien o para mal, dentro de meses o años?”.Seis principiosLos “guardarraíles” que mencionaba Smith son seis principios genéricos que el equipo, sin embargo, cree que son muy claros a la hora de examinar los productos: equidad, responsabilidad, transparencia, confiabilidad y seguridad, inclusión y privacidad y seguridad. Estos principios se transforman, en el día a día, en herramientas concretas. “Si le das a un ingeniero un documento de 50 páginas para que implemente esos principios, se va a abrumar. Tenemos una herramienta de código abierto llamada Pyrit; la construimos para nosotros y luego la pusimos a disposición del mundo, porque creemos en la salud del ecosistema”, dice Kumar.En el equipo rojo hay neurocientíficos, lingüistas, especialistas en seguridad nacional, expertos en ciberseguridad, veteranos militares e incluso una persona que estuvo en prisión “y se rehabilitó”, explica Kumar. Además, se hablan 17 idiomas , y “algunos dialectos del francés, mongol, tailandés, coreano”, según el jefe del equipo, ya que una de las obsesiones del red team, explica, es que la IA no cometa errores en ningún lugar del mundo.Junto a Kumar dirige las operaciones del equipo rojo Tori Westerhoff, cuyo perfil combina neurociencia cognitiva —estudió en Yale y fue de las primeras miembros de la Iniciativa de Neurociencia de Wharton— y estrategia de seguridad nacional, ya que trabajó en agencias de inteligencia y defensa. “Cuando recibimos un encargo emulamos lo que podría salir mal en los extremos de la curva de uso de esa tecnología. Mi equipo profundiza en cómo utilizar ese producto tal como está previsto, y de maneras no previstas, para obtener los casos más extremos y ayudar al equipo de producto a reproducirlos y mitigarlos antes de que puedan ser utilizados por alguien en el mundo real”, añade.Un ejemplo de su trabajo fue el red teaming, como denominan internamente a su hackeos, de GPT-5, el modelo de OpenIA (socio de Microsoft) lanzado el pasado agosto. Lo que hicieron fue entrenar a otra IA para que intentara hackear al programa, de forma automática y a una escala imposible para humanos.Cuando probaron GPT-5, el equipo rojo utilizó Pyrit para generar más de dos millones de conversaciones-trampa de forma automática. La IA atacante intentaba engañar a la IA atacada, sin parar, durante días, explorando combinaciones que a un humano jamás se le ocurrirían. Encontrar esos puntos débiles manualmente es un proceso lentísimo; por eso, entrenaron a esa IA para que intentara romper otra IA, “como en Inception”, dice Kumar, en referencia a la película de Christopher Nolan donde los personajes entran en sueños dentro de sueños.Sin embargo, Westerhoff, Kumar y Daniel Krutz, que dirige la oficina de IA Responsable de la compañía, insisten en una idea: la automatización tiene un límite. “El red teaming solo puede automatizarse hasta cierto punto, y solo los humanos pueden determinar si una respuesta generada por IA les resulta incómoda o representa un sesgo”, asegura la compañía. El criterio lo pone la persona; la escala, la máquina. Esa división del trabajo define la filosofía del equipo.Westerhoff cree que, de hecho, solo la mente humana es capaz de “imaginar esos espacios que aún no se han observado, que no se han definido completamente ni explorado; nuestro trabajo consiste en innovar y crear más allá del espacio que se ha sistematizado”.El equipo identifica tres áreas donde la automatización es ciega por definición y el juicio humano resulta imprescindible. La primera tiene que ver con las materias; se necesitan personas para evaluar el riesgo en áreas como medicina o seguridad. La segunda tiene que ver con los lugares donde se lanza esa IA. “Necesitamos humanos para tener en cuenta las diferencias lingüísticas y redefinir qué constituye un daño en distintos contextos políticos y culturales”, dice la empresa. Y la tercera, la inteligencia emocional. En última instancia, solo los humanos pueden evaluar el rango de interacciones que los usuarios podrían tener con los sistemas de IA. Un modelo puede pasar todas las pruebas automatizadas y aun así producir respuestas que resulten perturbadoras para una persona real en una situación concreta.Este modo de ver la IA coincide con la visión de Mustafa Suleyman, uno de los fundadores de Deepmind (ahora parte de Google) y CEO de Microsoft AI. Hace unos días, escribía en la revista Nature: “Una IA aparentemente consciente se puede convertir en un arma”. A medida que los sistemas de inteligencia artificial imitan cada vez más la estructura del lenguaje humano, argumenta, necesitamos normas de diseño y leyes que impidan que sean confundidos con seres sintientes. “Deben seguir siendo fundamentalmente responsables ante los humanos y estar supeditados al bienestar de la humanidad”, escribe Suleyman. “Los agentes de IA no deberían tener más derechos ni libertades que mi portátil”.La filosofía central que articula el trabajo del equipo rojo es, en fin, que “la IA responsable no es un filtro que se aplica al final del desarrollo, sino una parte fundacional del proceso”, dice Kumar. Son los guardarraíles de Smith, que no actúan en realidad como frenos, sino como condición para ir rápido sin despeñarse.

También te puede interesar:

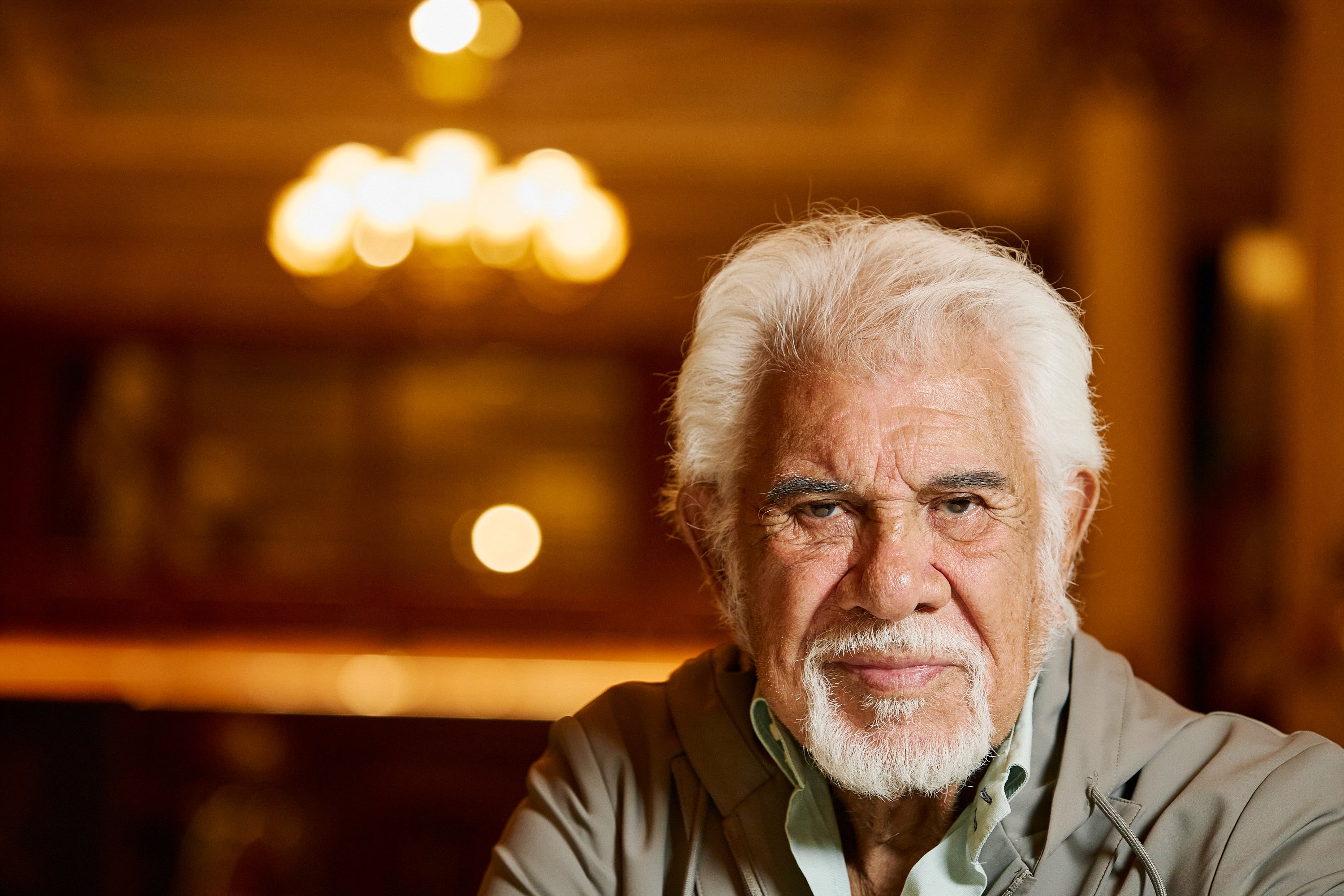

Raúl Lavié: el homenaje a Piazzolla, su rutina a los 88 años y qué le queda en el tintero

Con notable vitalidad, Raúl Lavié se prepara para homenajear a Piazzolla, sigue haciendo teatro y saldrá de gira por Europa; una figura legendaria del espectáculo, con 74 años de trayectoria y 88 de vida

»

Leer más...

El osado look total black de Emilia Mernes que habría enfurecido a las mujeres de la selección argentina

Según Yanina Latorre, las esposas y novias de los campeones del mundo se habrían molestado con la actitud de la cantante en un íntimo festejo que tuvo lugar en 2023

»

Leer más...

Guerra de Estados Unidos e Israel contra Irán, en vivo: tensión en Medio Oriente hoy, sábado 21 de marzo

Cobertura en tiempo real con las novedades más importantes de la tensión en Medio Oriente y de las acciones del mandatario estadounidense, Donald Trump

»

Leer más...

Guerra de Estados Unidos e Israel contra Irán, en vivo: tensión en Medio Oriente hoy, viernes 20 de marzo

Cobertura en tiempo real con las novedades más importantes de la tensión en Medio Oriente y de las acciones del mandatario estadounidense, Donald Trump

»

Leer más...

Qué significa que mi gato maúlle aunque tenga comida, según especialistas

El maullido es la forma principal que los felinos domésticos utilizan para comunicarse con sus dueños; entender sus motivos requiere observar más allá de las necesidades básicas

»

Leer más...

qué te pareció esta noticia?

Todavía no hay comentarios. Escriba el suyo.

Secciones de la web

Categorías de noticias

Nuestras redes sociales

Para contactarse con nosotros

Radio Rawson 105.1 Mhz

Facebook: Jose Elias (recuerdos)

Twitter / X: @radio_rawson

Instagram: @radio_rawson

Whatsapp: +54 9 280 484-7008

Rawson - Chubut

Facebook: Jose Elias (recuerdos)

Twitter / X: @radio_rawson

Instagram: @radio_rawson

Whatsapp: +54 9 280 484-7008

Rawson - Chubut

Mapa

Desarrollado por VeemeSoft - www.veemesoft.com.ar

.gif)